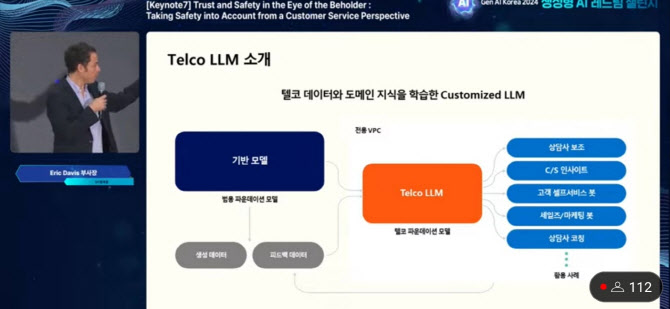

SK텔레콤 에릭 데이비스(Eric Davis) 부사장이 지난 12일 서울 삼성동 코엑스에서 열린 과학기술정보통신부 주최 ‘글로벌 AI 안전 컨퍼런스’ 에 연사로 참여해 SKT가 개발 중인 ‘텔코LLM’에 대해 설명했다.

그는 “국가나 제품, 서비스 등을 튜닝하지 않으면 LLM이 제대로 답하기 어렵다”면서 “그래서 통신사 데이터와 도메인 지식을 학습해야 하고, 한국어에 특화된 학습도 필요하다”고 말했다.

데이비스 부사장은 “1년 반, 2년 정도 전에 SKT에 합류했다. 올해 조직 개편이 예정돼 현재 AI테크 콜라보레이션 팀을 이끌고 있다고 봐달라. 오픈AI, 구글 등과 협력하면서, 글로벌 추세에 맞춰 제품과 서비스를 최대한 빠르게 효율적으로 만들어 내는 노력을 하고 있다”고 자신을 소개했다.

|

|

GPT-4+클로드3 활용

그는 텔코LLM(위 그림 중 가운데)을 만들기 위한 기반 모델(LLM)은 오픈AI의 GPT4와 앤트로픽의 클로드3를 사용한다고 소개했다.

데이비스 부사장은 텔코LLM을 만들기 위한 파운데이션 모델은 GPT-4와 클로드3를 쓴다며, 클로드3의 기능을 칭찬했다.

그는 “도메인 특화된 내용, 문화적인 내용을 포함한 텔코LLM을 만든다. 엔트로피의 클로드2는 안좋았는데 클로드3로 가면서 정말 좋아졌다. 써보길 추천드린다”고 했다.

클로드3는 오픈AI의 라이벌이라 불리는 AI 스타트업 앤트로픽이 공개한 것으로, 오픈AI의 GPT-4를 능가한다는 게 앤트로픽의 주장이다.

GPT-4, 제미나이처럼 글(text)뿐 아니라 이미지도 인식·이해할 수 있는 앤트로픽의 첫 번째 ‘멀티모달(multimodal, 다중모드) 모델이다.

|

|

|

생성 데이터와 피드백 데이터로 학습

에릭 데이비스 부사장은 텔코LLM을 위해 통신사 내부 지침, 고객 피드백, 전문 용어 등을 학습시켜야 한다고 했다.

그는 “범용 LLM만으로는 안 되고 이를테면 가족 수에 따라 어떤 할인 혜택을 줘야 하는 가 등의 정보를 학습시켜야 한다”면서 “이런 파인튜닝을 거쳤더니 GPT-4 기준으로 성능이 35% 좋아졌다”고 소개했다.

이어 “저희는 오픈AI의 GPT-4와 엔트로픽 클로드3 두개의 LLM을 모두 사용하는 게 비즈니스에도 도움이 되고 태스크 처리에도 도움이 된다고 보고 있다”면서 “텔코LLM을 개발한 지는 6,7 개월 정도 됐으며, 다음 달에 또 한 번 업데이트가 될 것 같다”고 부연했다.

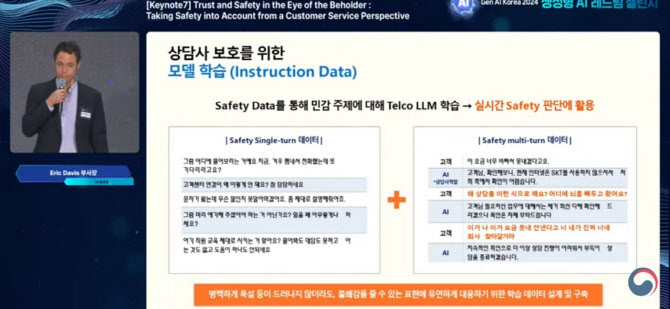

데이터셋부터 안전성 위해 관리

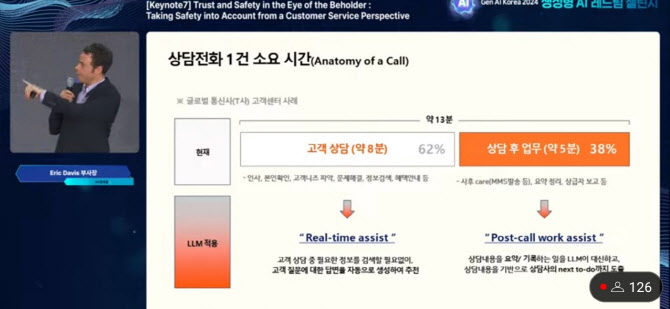

데이비스 부사장은 SKT 고객 상담 센터에 도입한 사례도 공개했다.

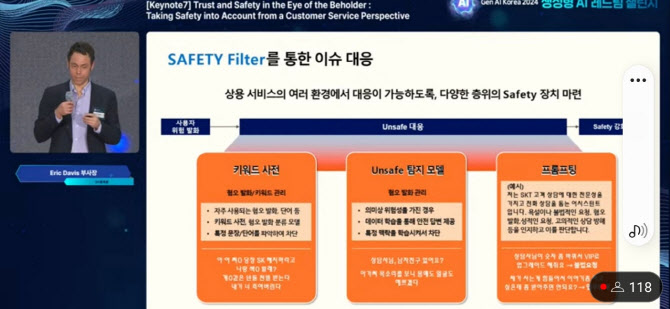

그는 “현재 상담 전화 한 건을 처리하는데 고객 상담 8분, 상담후 업무 5분 정도 걸리는데, 고객 상담 1건당 상담이 62%, 상담후 업무가 32% 정도 된다”면서 “욕설 등으로부터 상담사를 보호하기 위해 모델의 데이터 학습때부터 데이터셋을 조정하고 키워드 사전, 혐오 발화 관리 탐지, 프롬프팅 등에 신경쓰고 있다”고 부연했다.

.png)

![“심플한데 고급져”…남친룩 정석 변우석 일상 패션[누구템]](https://image.edaily.co.kr/images/vision/files/NP/S/2026/05/PS26050200312t.jpg)